计算化学公社

标题: 杂谈:手搓高性价比GPU集群 [打印本页]

作者Author: Entropy.S.I 时间: 2024-8-28 23:54

标题: 杂谈:手搓高性价比GPU集群

本帖最后由 Entropy.S.I 于 2024-8-29 02:57 编辑

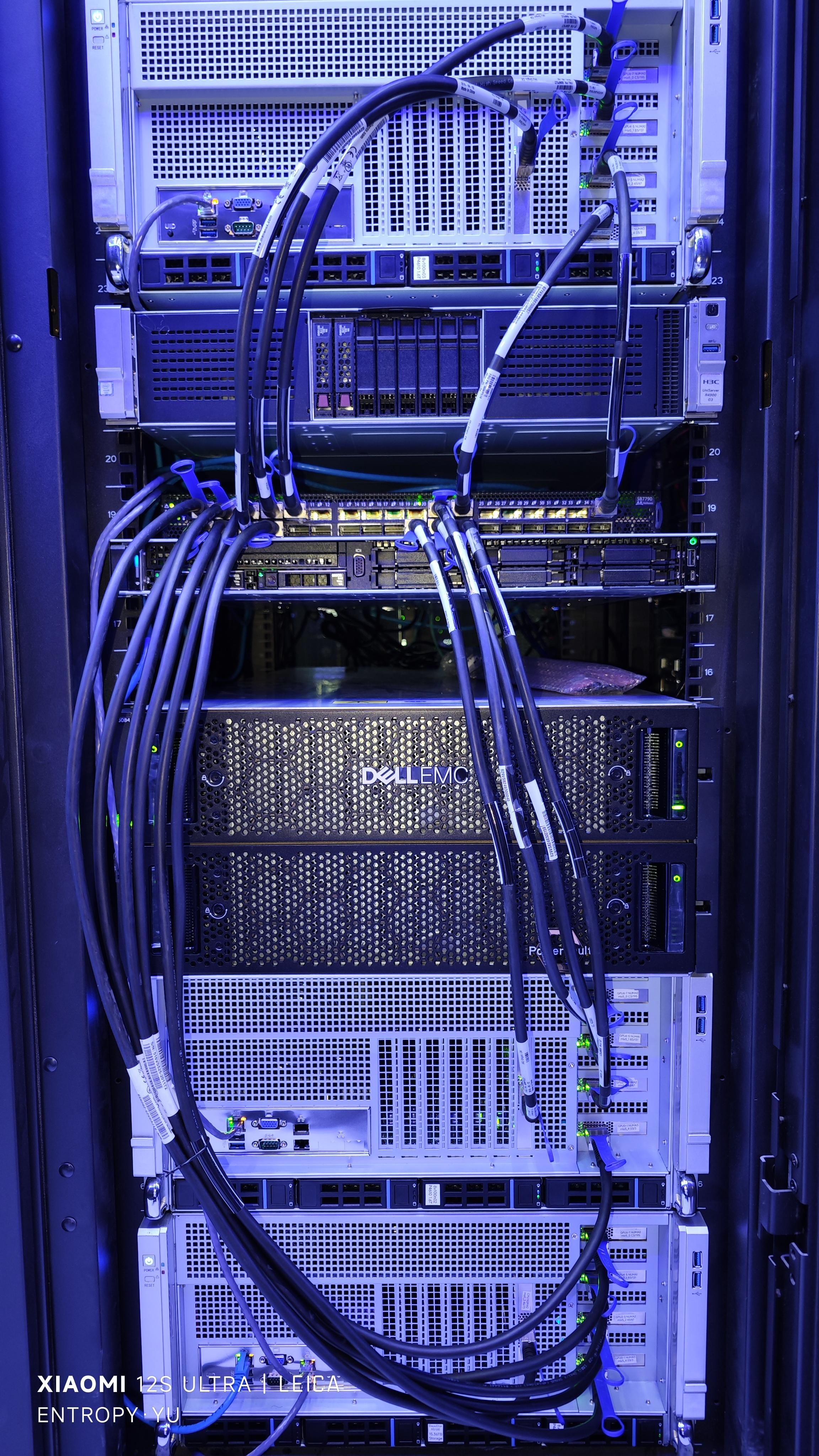

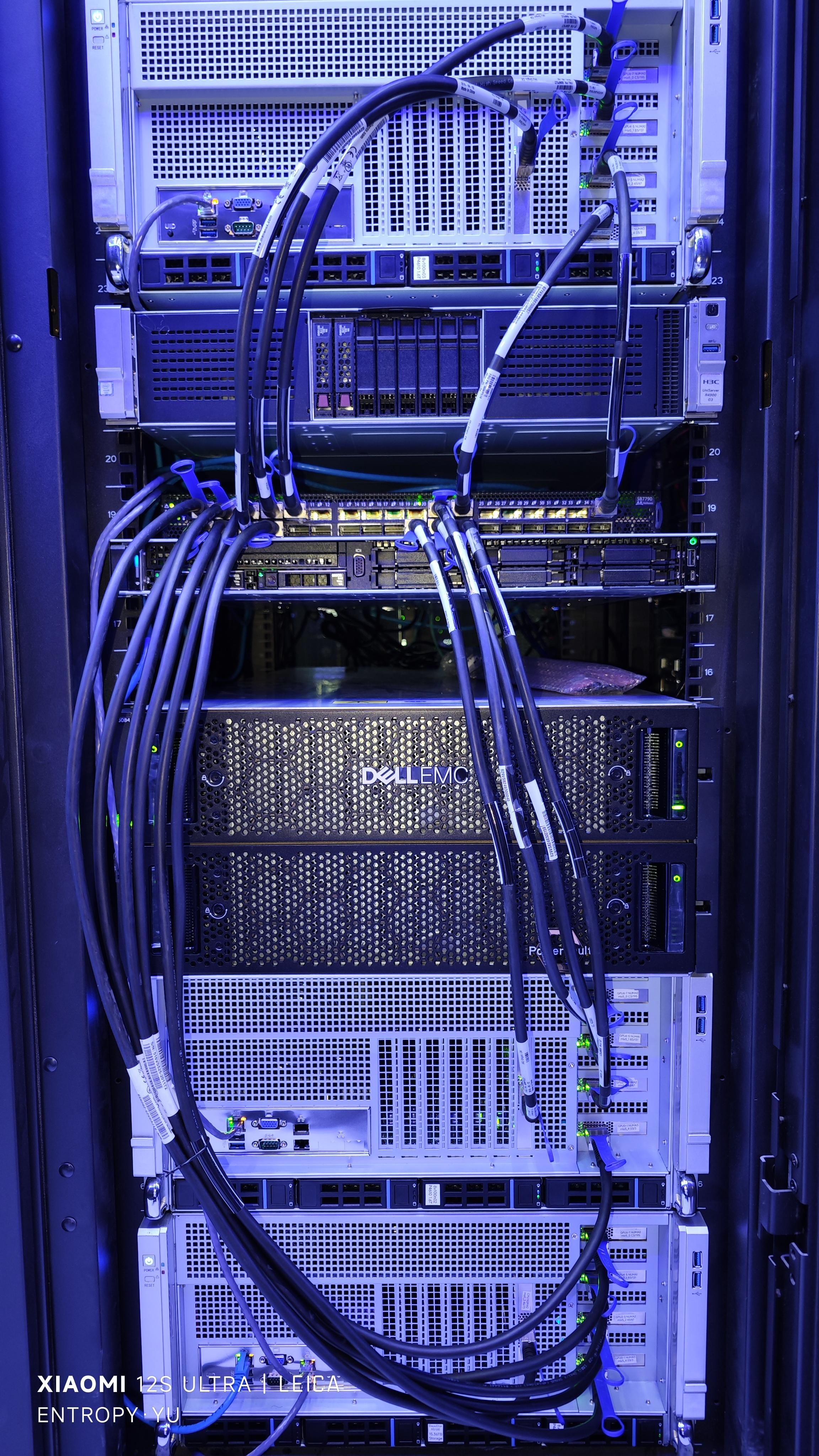

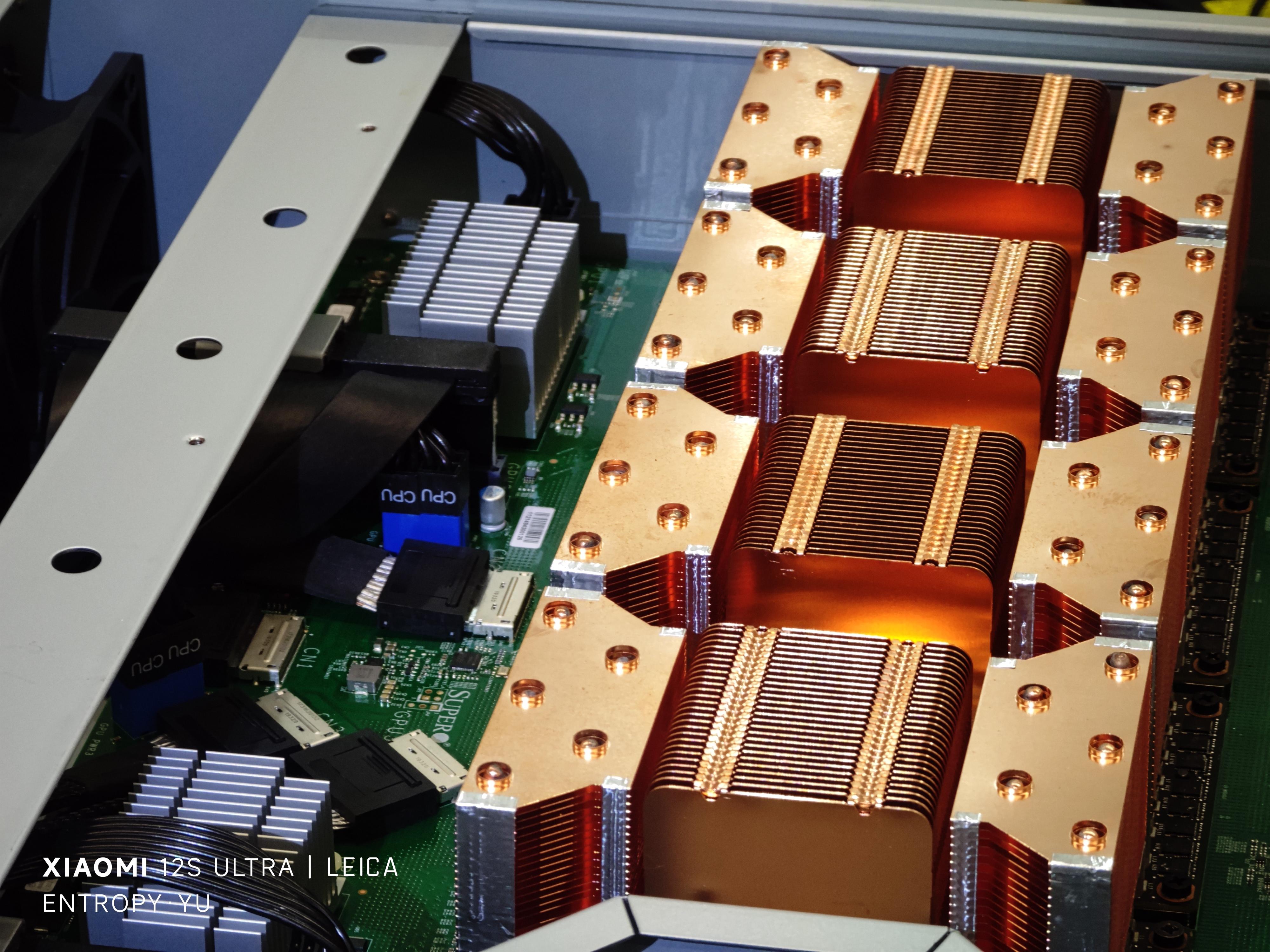

基于自己开发的服务器搭建的这套GPU集群已经在自己课题组里上线运行了一段时间,硬件如p1~6所示,跨节点并行计算性能完全符合预期,同时很稳定,至今从未出现过“掉卡”问题,比一些基于“大厂准系统”的8卡4090机器稳定多了。

目前只上架了3个计算节点,24块V100 SXM2 16GB,还不是“完全体”,主要原因是机房capacity不足(白嫖机房还要啥自行车),等几个月后学校的新机房建成,也许有机会进一步扩展。

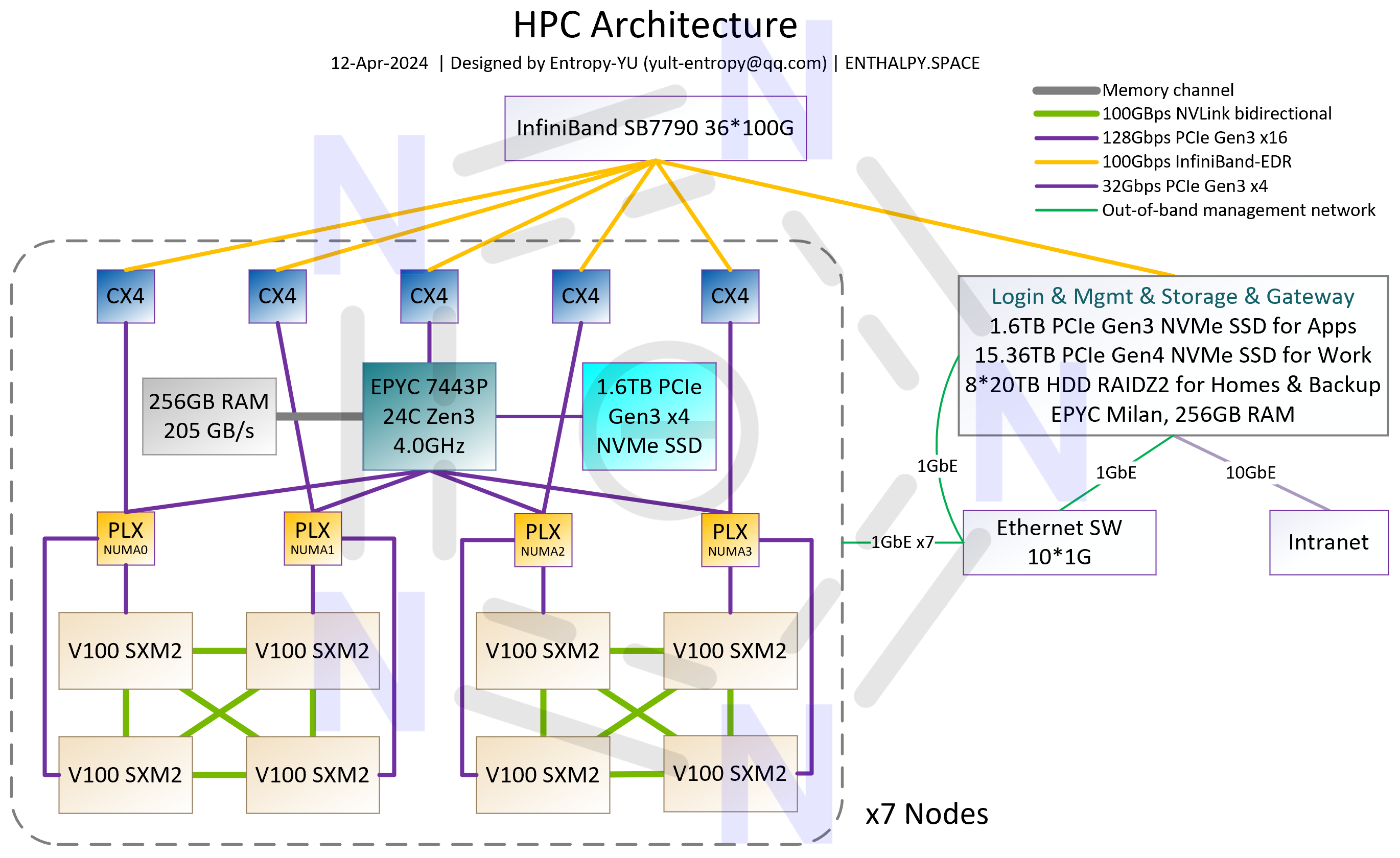

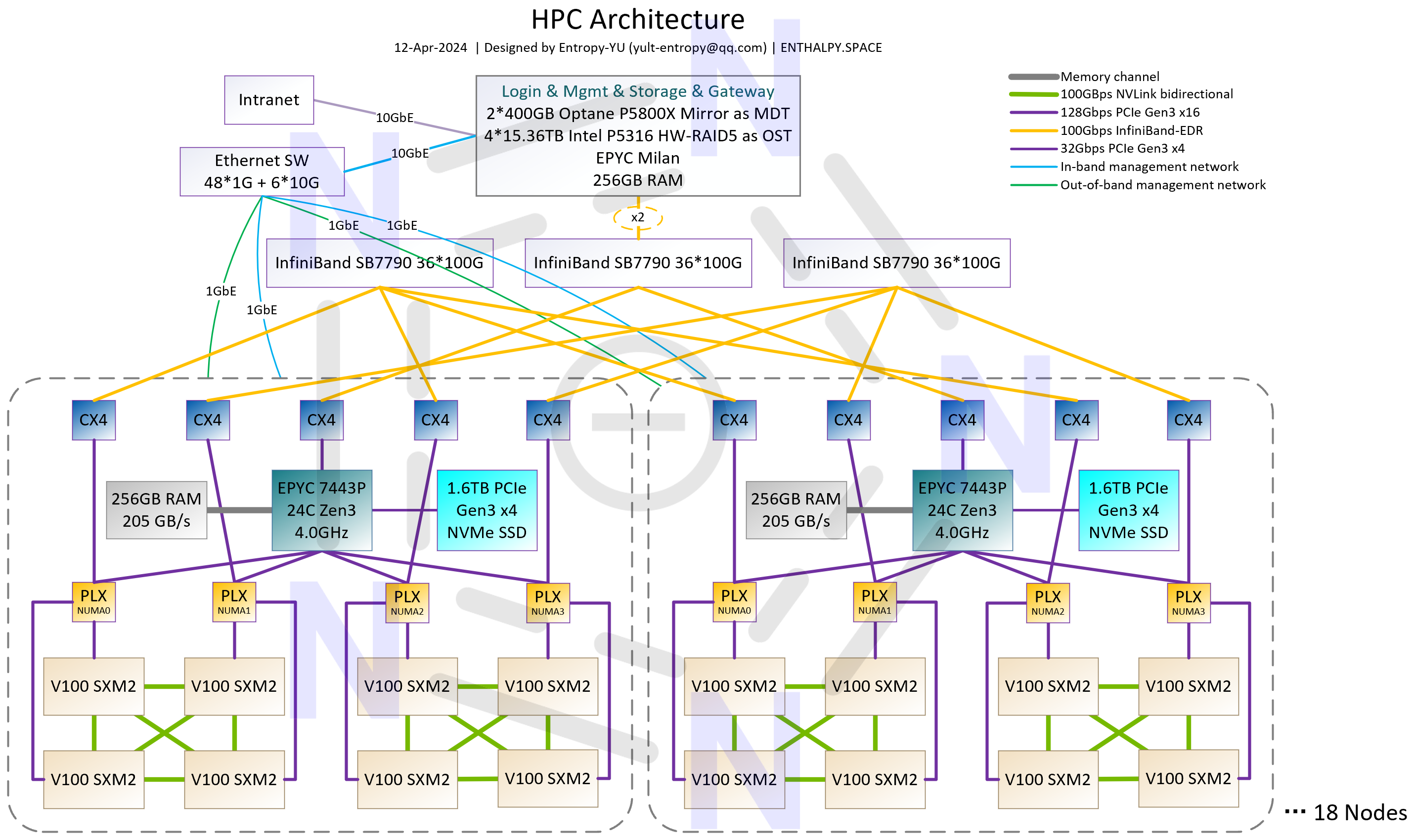

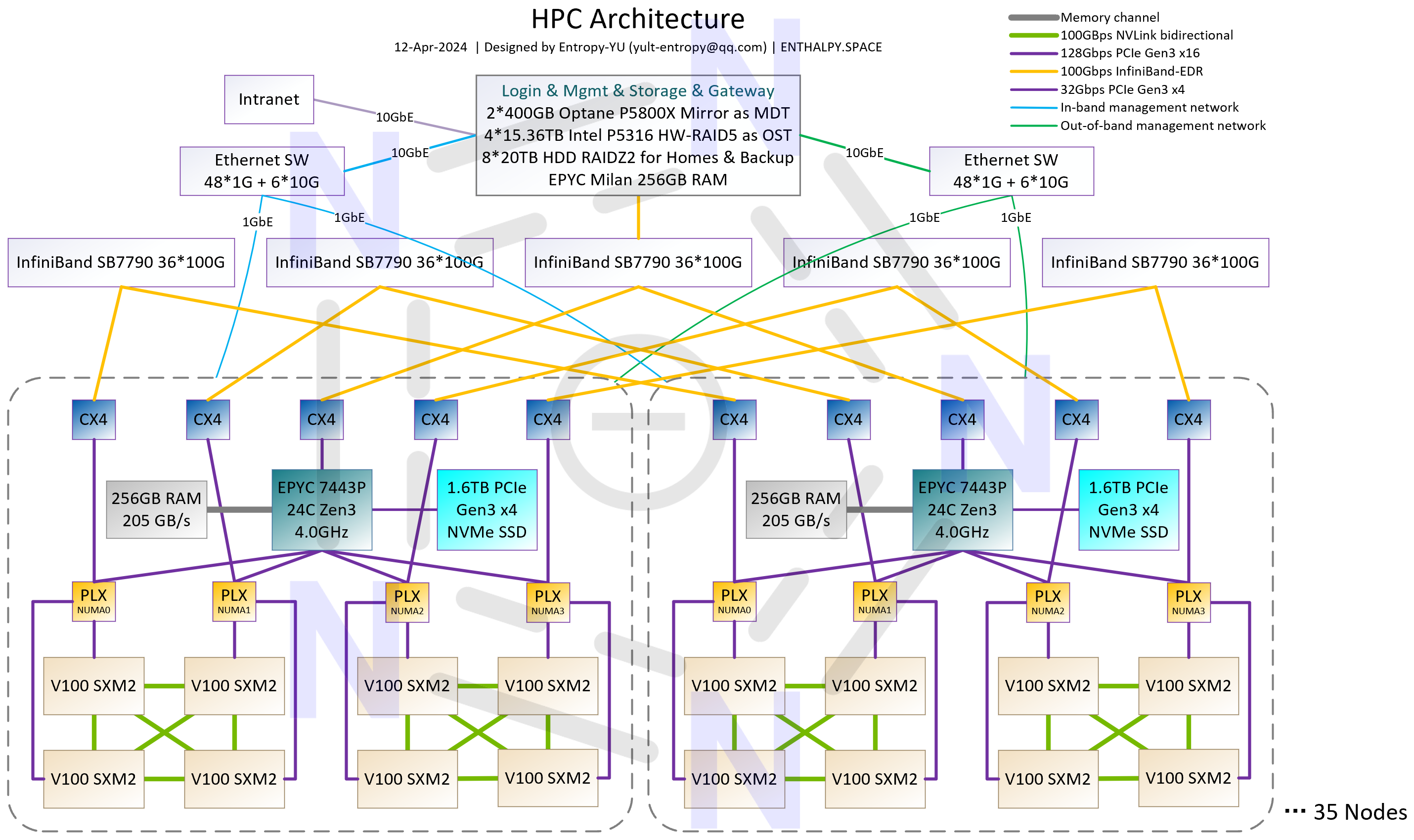

“完全体”有3种规模,架构分别如p7~9所示。其中p8的144-GPU配置是最理想的状态——从架构上来说,平衡了集群规模和通信效率;从成本来说,IB连接线可以全部采用廉价的DAC铜缆;从实施来说,刚好用满3个2x10kW容量的标准机柜。对于大多数搞科学计算研究的实验室来说,有一套由144块V100组成的、架构类似于初代NVIDIA DGX SuperPOD(核心特性是GPU-Direct RDMA)的、支持全机组高效并行的GPU集群,就可以做“很多事情”了。

这套集群中,CPU、GPU、IB HCA、IB交换机、IB DAC铜缆都是二手的,计算节点是由我“二次开发”的,有大量的定制配件。所有硬件都是公费采购,计算节点每台4万CNY,IB交换机每台8000CNY,IB DAC铜缆根据长度从70~280CNY不等。144-GPU的“理想配置”,不到80万CNY就能搞定,对于绝大多数科学计算和AI4S 应用,性能都可以达到一台HGX-H100-8GPU服务器的3-4倍,而后者目前的单价超过250万CNY;也就是说,此方案在硬件层面的性价比是H100的10倍以上。

硬件细节和具体应用场景下case-by-case的测试以后有空再发文细说。几个月前就想发一些benchmark文章讨论GPU加速在第一性原理计算以及一些AI4S应用中的实际性能,顺便介绍我自己二次开发的服务器,但是由于各种原因一直推迟,不同平台的benchmark数据倒是积累了快1000条了……

作者Author: wxyhgk 时间: 2024-8-29 13:00

有钱真好

作者Author: wakakasa 时间: 2024-8-29 15:56

有钱真好,水平也真高,我只想要一套1万以内的GPU配置

作者Author: 目前还不会计算 时间: 2024-8-30 15:27

我配件刚卖了,还剩下个cpu, 今天看到你发8卡服务器的图,终于找到了主板的型号。

作者Author: Entropy.S.I 时间: 2024-9-7 21:02

本帖最后由 Entropy.S.I 于 2024-9-8 00:01 编辑

看到很多人搞不明白Slurm的CGroup相关配置以及GPU-NUMA Affinity的问题,甚至一些“大厂工程师”都搞不明白(如http://bbs.keinsci.com/thread-47523-2-1.html #19楼),遂在此潦草写几句。

http://bbs.keinsci.com/thread-31472-1-1.html 此贴所述方法不优雅、非主流、功能残疾

使用正确版本的OS和Slurm,从头编译安装Slurm,添加合适的编译参数,正确配置CGroup、GRES以及一些Partition参数,即可实现Job之间资源隔离(job只能看到分配给自己的GPU和CPU,故GMX命令不需要设置GPU_ID和pinoffset)、实现GPU-NUMA Affinity(为GPU分配最近的CPU)。用户最少只需要在sbatch脚本中指定1行参数(gpu数量),其余参数全部默认,即可自动获得当前硬件平台下的最优性能。

对于多节点的情况,启用pam_slurm_adopt,正确配置/etc/pam.d、/etc/security目录下的配置文件,即可实现:用户在没有Job时无法登录计算节点,有Job时登录计算节点只能看到节点上最近一个Job的资源。

至于具体操作,务必不要follow除Slurm官网手册以外的任何资料,无论中英文。

(, 下载次数 Times of downloads: 159)

(, 下载次数 Times of downloads: 155)

(, 下载次数 Times of downloads: 152)

(, 下载次数 Times of downloads: 149)

(, 下载次数 Times of downloads: 153)

(, 下载次数 Times of downloads: 154)

作者Author: 是ystian 时间: 2024-9-25 13:46

老师您好,最近我自己尝试配了双2080ti的主机进行VASP的计算,还购买了NVlink对两张卡进行连接,我想请教您NVlinke对于显卡的计算速度有没有提升。我询问这个问题的原因是,经过自己的测试好像NVlink没有起到提速的作用,也或许是因为没有正确对NVlink的部分进行设置有关?请您不吝赐教。

作者Author: 娃哈哈666 时间: 2024-10-11 15:00

你好,请问两张2080ti跑vasp计算快吗?我看vasp好像比较吃双精度算力,我这里有一张P100感觉速度还可以,我想看看2080ti的速度如何

作者Author: 是ystian 时间: 2024-12-12 10:31

速度还可以,就是最终计算结果在复杂情况下和CPU计算结果有出入。我之前也想上P100,但是害怕坏卡率太高,没买P100

作者Author: xujc1983 时间: 2024-12-18 11:18

借宝地问一句:

1张P100速度还可以?

我自己的1张P100跑起来,怎么感觉比多核CPU要慢很多,不清楚哪里没有搞对

而且还是ACC版的

作者Author: ljb874722957 时间: 2024-12-25 12:29

老师您好,为什么我配置的3080比集群上A4000的要慢,一样的vasp版本,一样的输入文件,是由于编译的原因吗?

作者Author: enine 时间: 2024-12-31 09:44

这个手搓版GPU有意思,一个单路主板带这么多GPU,我看主板是TYAN s8030的吧!有创意

作者Author: 娃哈哈666 时间: 2026-2-28 17:02

需要CPU单核性能比较强的才能完全发挥GPU的速度,并且是当时觉得速度还可以,现在换了V100了,一张V100比两张P100还快

| 欢迎光临 计算化学公社 (http://bbs.keinsci.com/) |

Powered by Discuz! X3.3 |